没有谷歌(Google),我们该怎么办?我们的问题几乎都能透过谷歌搜索引擎找到答案,而且随着时间的推移,以及新增了功能,它变得更加智能和完善。谷歌甚至在Search On活动中,宣布了几个可以帮助 “阅读你思想 ”的新功能。

其中一个功能是Google Lens工具,让你用文字和照片进行搜索;另一个主要功能是 “Things To Know”,它能提供通常与你的搜索有关的答案。这两个功能都是由“多任务统一模型”(Multitask Unified Model,简称MUM)提供的。

谷歌表示,MUM不仅能理解语言,它还能通过从图片、音频和视频等文本以外的格式获取信息来生成语言。它还在75种不同的语言和许多不同的任务中同时进行训练,使它能够比以前的模型对信息和世界知识形成更全面的理解。

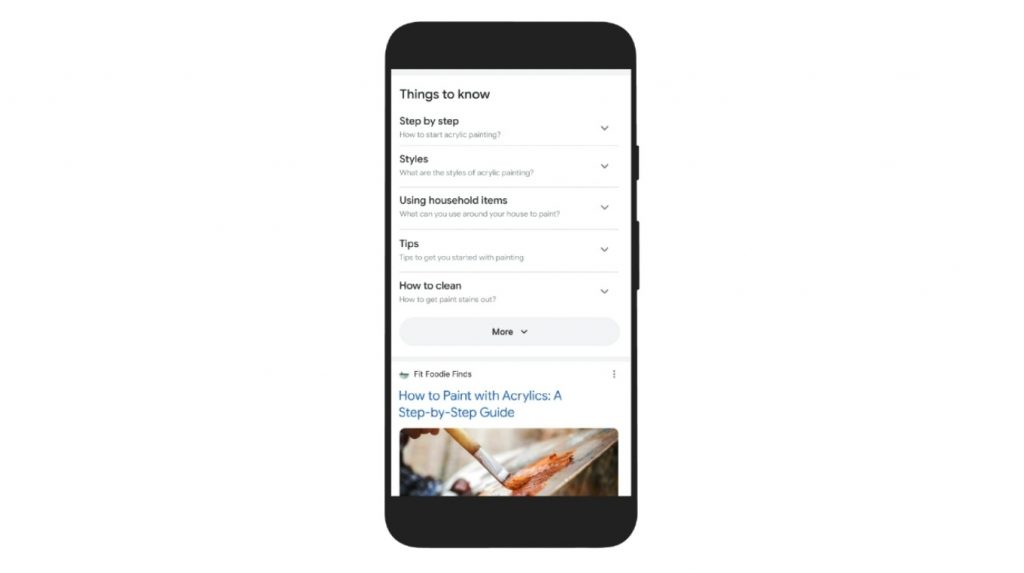

“Things To Know”

有了他们的 “Things To Know”,谷歌将为你提供标准文本搜索术语之外的内容。这意味着,如果你对搜索的内容感到困惑,或不知道该用哪个词汇或短语,它都能帮助你。

如果你在谷歌搜索一个术语,你将能够往下滑到 “Things To Know”部分,在那里它的人工智能将扩展你的搜索,并引导你进入一个 “未知的世界”。例如,如果你试图搜索 “丙烯颜料”,“Things To Know”部分会出现对丙烯颜料的描述,以及你可以在哪里买到它。

另外,还有关于如何使用丙烯颜料的链接、与这种类型的绘画有关的风格,以及关于技术和如何从家里的东西开始的提示。

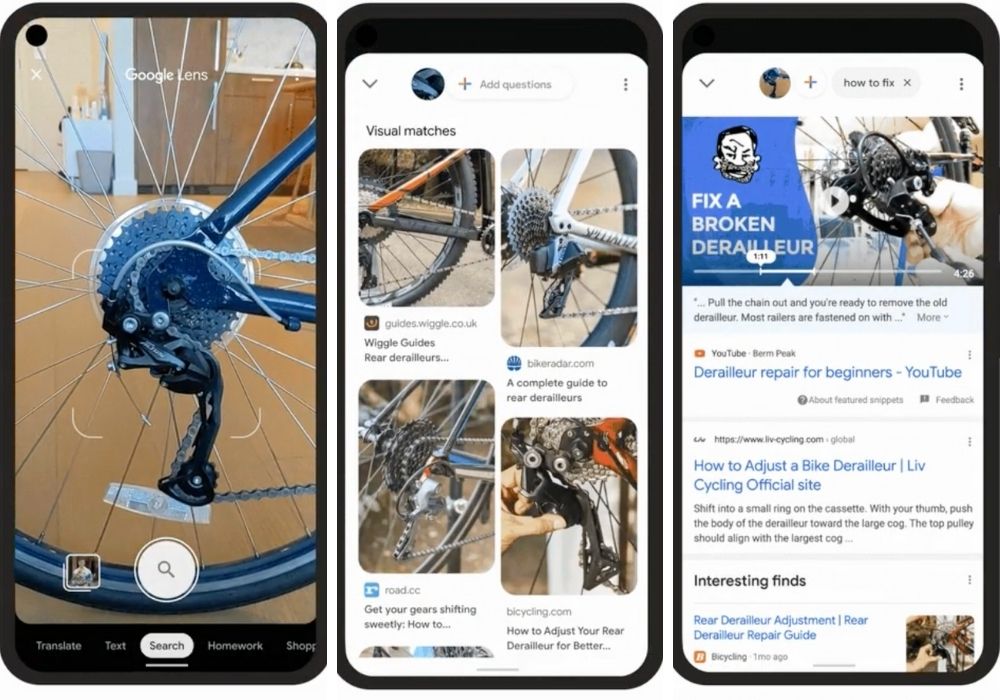

Google Lens搜索

Google Lens将能够根据你用它拍摄的照片猜测你想要搜索的内容。例如你可以通过Google Lens拍一张脚车的照片,上面有一个坏掉的变速器(因为不是每个人都知道变速器是什么),然后输入 “如何修理”,谷歌就能识别你的意思,并帮助你搜索结果。

Google Lens的这些功能要到明年初才会推出,目前还不清楚它是否会出现在独立的Google Lens应用程序,或者是否会出现在安卓手机默认的相机应用程序。

谷歌还将使用机器学习来识别视频中的时刻,并识别与场景相关的主题,比如识别视频标题或描述中未提及的特定动物。该功能将在 “未来几周内 ”推出,并在未来几个月内进行更多的 “视觉增强”。

谷歌搜索引擎的其他新功能将是 “Refine this search”和 “Broaden this search”,这将有助于你找到更多答案,或者找到更精准的答案。这些功能也将在未来几个月内推出。